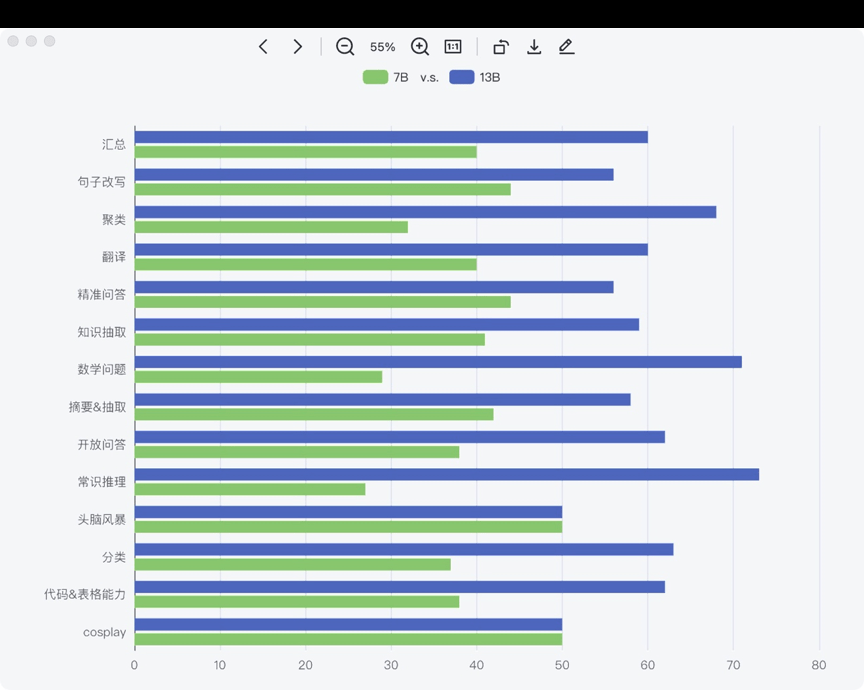

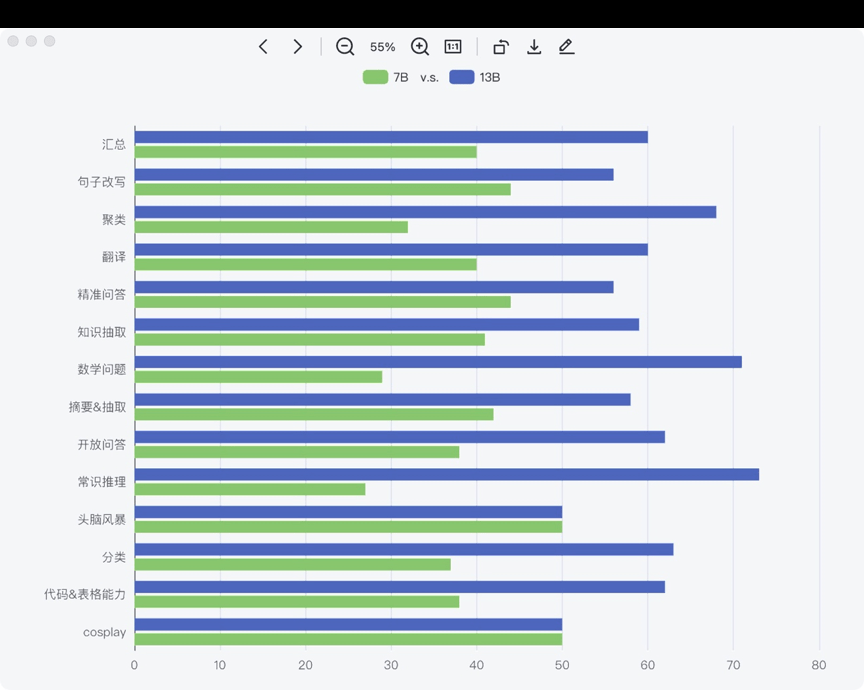

7月11日,百川智能正式发布参数量130亿的通用大语言模型Baichuan-13B-Base、对话模型Baichuan-13B-Chat及其INT4/INT8两个量化版本。

这是百川智能发布的第二款通用大语言模型,而在前不久的6月15日,百川智能就已经推出了首款70亿参数量的中英文语言模型Baichuan-7B。

百川智能在发布预训练模型Baichuan-13B-Base的同时还发布了其对话模型Baichuan-13B-Chat,Baichuan-13B-Chat部署简单、开箱即用,极大降低了开发者的体验成本。

百川智能表示,相比此前发布的Baichuan-7B,Baichuan-13B在1.4万亿token数据集上训练,超过LLaMA-13B 40%,是当前开源13B尺寸下训练数据量最大的模型,

据百川智能介绍,Baichuan-13B上下文窗口长度为4096,不同于Baichuan-7B的RoPE编码方式,Baichuan-13B使用了ALiBi位置编码技术,能够处理长上下文窗口,甚至可以推断超出训练期间读取数据的上下文长度,从而能够更好的捕捉文本中上下文的相关性,做出更准确的预测或生成。

百川智能表示,Baichuan-13B是一款中英文双语大模型,采用了相对平衡的中英文语料配比和多语言对齐语料,在中英两种语言上表现均很优异.

Baichuan-13B-Base目前不仅对学术研究完全开放,所有开发者均可通过邮件向百川智能申请授权,在获得官方商用许可后即可免费商用;此外,为了降低模型的使用门槛,百川智能同时开源了Baichuan-13B-Chat的INT8和INT4两个量化版本,在近乎无损的情况下可以很方便的将模型部署在如3090等消费级显卡上。

百川智能创始人王小川表示,“Baichuan-13B是百川智能为科技强国送上的一份礼物,我们期待国内大模型行业以及垂直领域能够在此基础上开发出更多优秀产品及行业应用,让技术在真实、丰富的应用场景中快速迭代创新,我们愿与众多企业、开发者一道为国内开源社区的生态繁荣贡献自己的力量。”

热门推荐

42岁阿隆索神了!药厂33场不败轰97球,三线都要冲冠:甩拜仁11分

42岁阿隆索神了!药厂33场不败轰97球,三线都要冲冠:甩拜仁11分 内饰动力全面升级 第九代凯美瑞将于3月初正式上市

内饰动力全面升级 第九代凯美瑞将于3月初正式上市 皇家娱乐红蓝开户客服薇【yyn2200182315】

皇家娱乐红蓝开户客服薇【yyn2200182315】 皇家国际游戏上下分客服电话联系方式薇【yyn2200182315】

皇家国际游戏上下分客服电话联系方式薇【yyn2200182315】 这球太诡!广东逆转广厦三连胜 周琦复出12+13+3帽

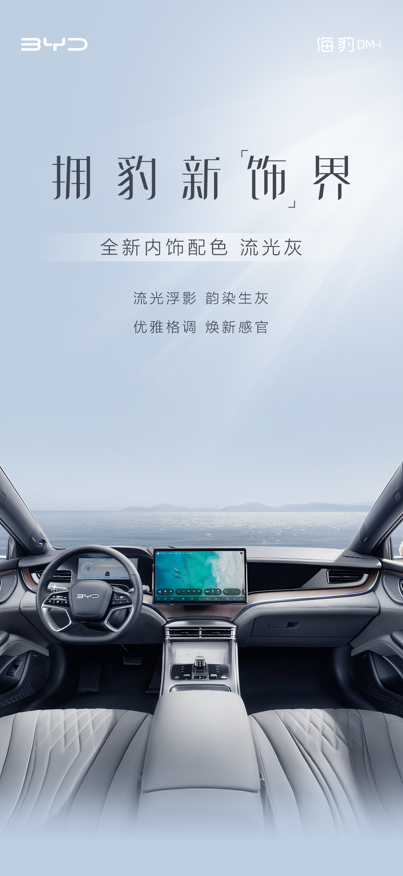

这球太诡!广东逆转广厦三连胜 周琦复出12+13+3帽 连续两月销量破万 海豹DM-i新增流光灰内饰配色

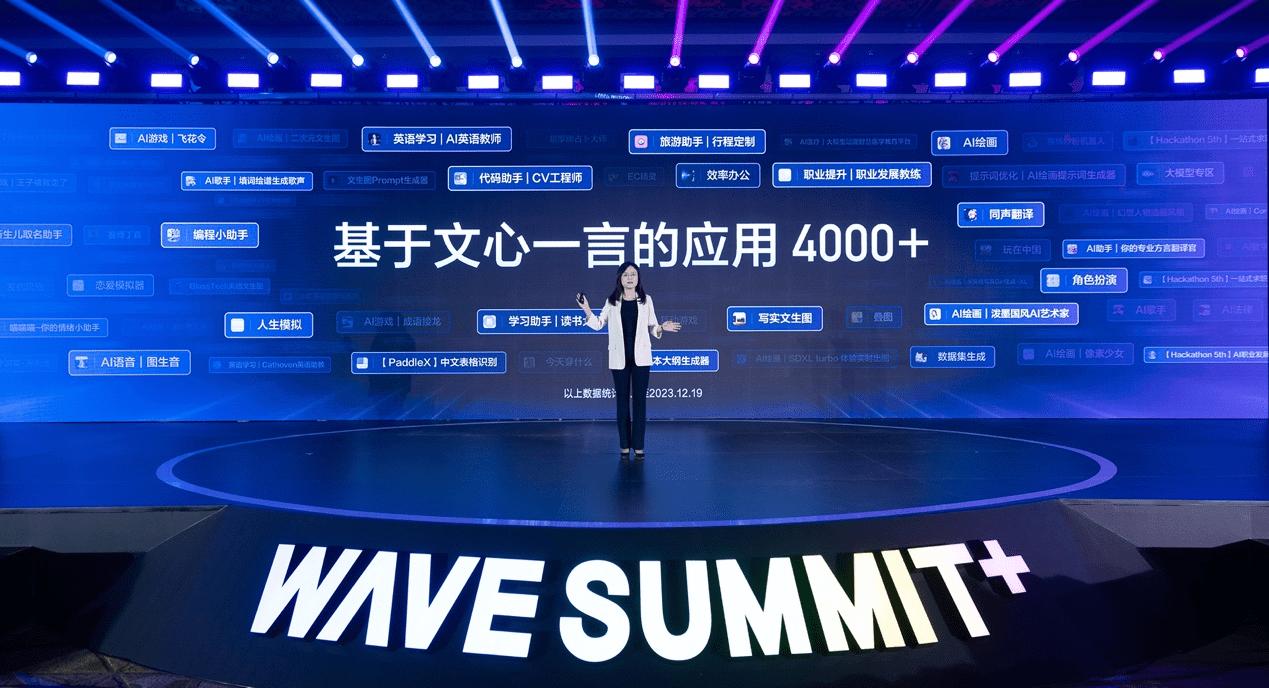

连续两月销量破万 海豹DM-i新增流光灰内饰配色 百度吴甜:文心一言创作37亿字文本,输出3亿行代码

百度吴甜:文心一言创作37亿字文本,输出3亿行代码 NBA裁判报告:字母哥关键补篮违例漏吹 太阳两次吃亏仍险胜尼克斯

NBA裁判报告:字母哥关键补篮违例漏吹 太阳两次吃亏仍险胜尼克斯 快速布局海外市场 雷达RD6在老挝正式上市

快速布局海外市场 雷达RD6在老挝正式上市 勒布朗32+11+6湖人逆转太阳 杜兰特38+9+5比尔24+4

勒布朗32+11+6湖人逆转太阳 杜兰特38+9+5比尔24+4 阿维塔12售30.08万起 标配高阶智驾和鸿蒙座舱

阿维塔12售30.08万起 标配高阶智驾和鸿蒙座舱 大帝谈哈登:本有机会夺冠 现在只能向前看

大帝谈哈登:本有机会夺冠 现在只能向前看 马自达CX-50行也HEV下线 搭2.5L混动和四驱

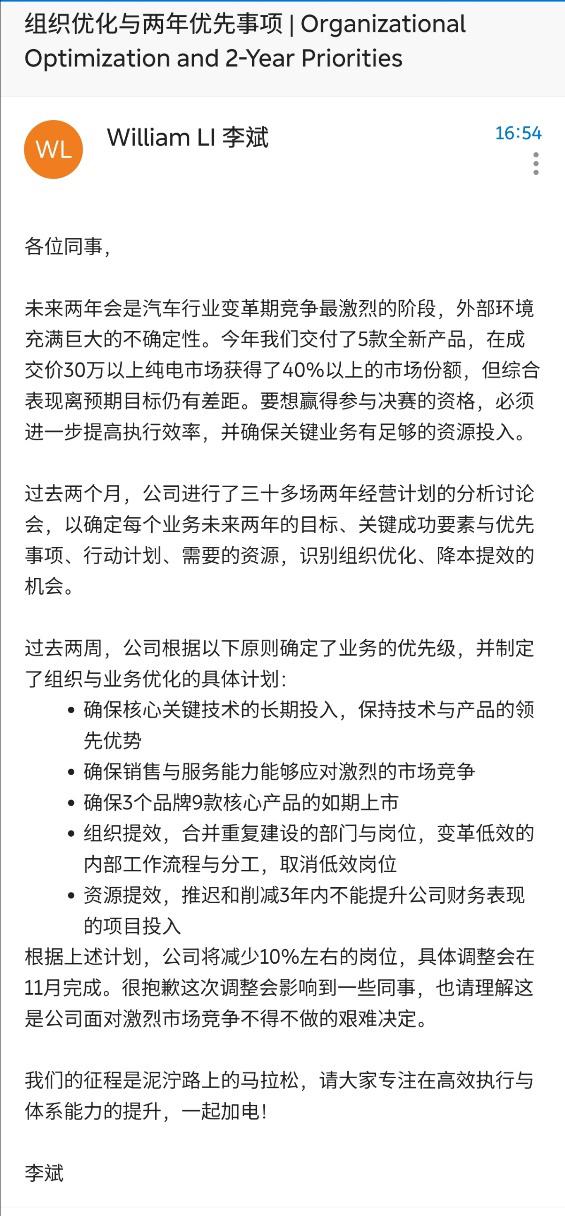

马自达CX-50行也HEV下线 搭2.5L混动和四驱 蔚来李斌回应裁员传闻:公司将减少10%左右的岗位

蔚来李斌回应裁员传闻:公司将减少10%左右的岗位 奥预赛-中国女足1-1韩国无缘巴黎奥运 王珊珊破门难救主

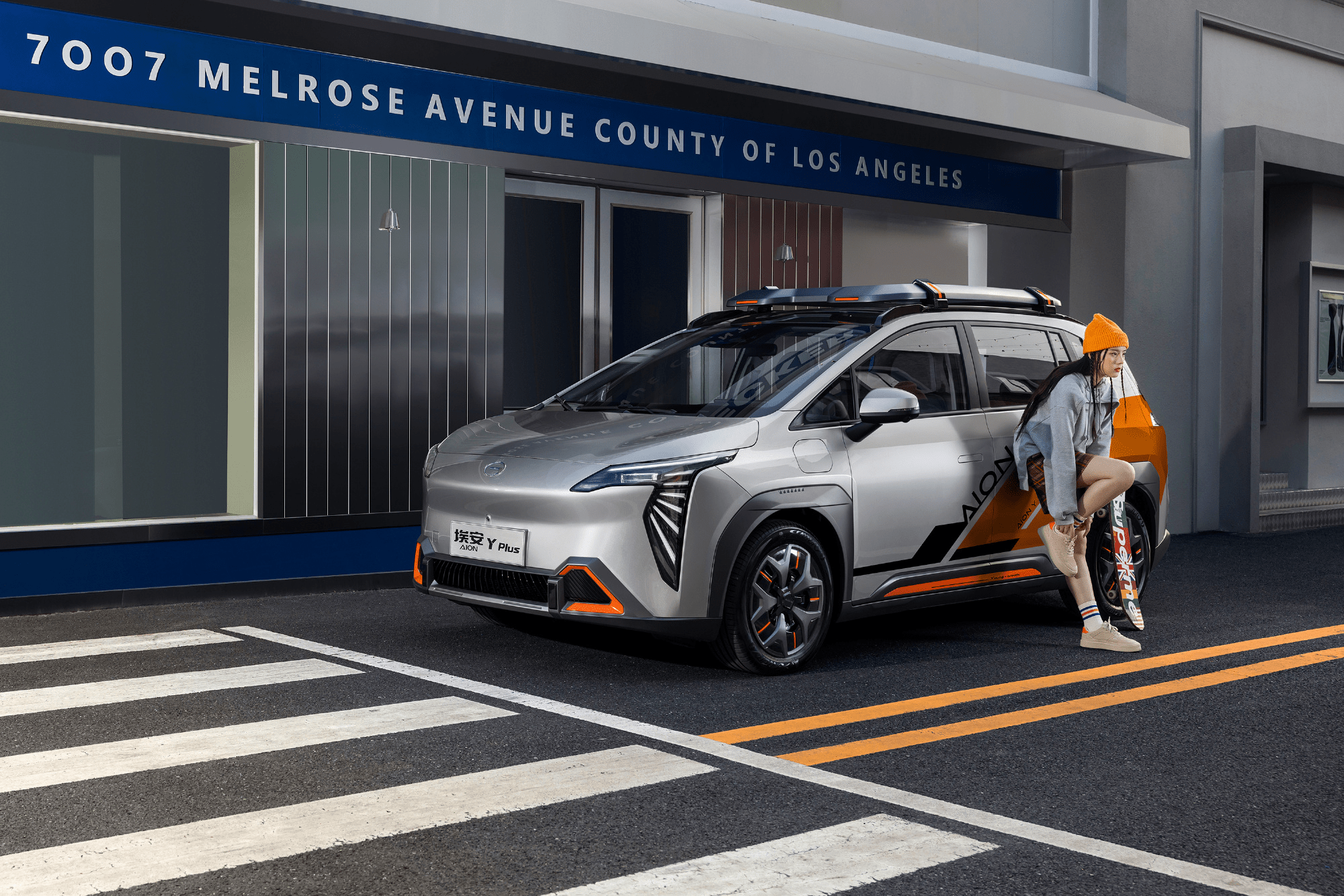

奥预赛-中国女足1-1韩国无缘巴黎奥运 王珊珊破门难救主 外观更具年轻化 AION Y Plus潮野版预售14.68万元

外观更具年轻化 AION Y Plus潮野版预售14.68万元 vivo发布自研蓝心大模型及蓝河操作系统、OriginOS 4

vivo发布自研蓝心大模型及蓝河操作系统、OriginOS 4 官方!梅西荣膺2023年金球奖,力压哈兰德第8次加冕,创造5大历史

官方!梅西荣膺2023年金球奖,力压哈兰德第8次加冕,创造5大历史 从300元暴跌到10元,网红葡萄“阳光玫瑰”为何跌落神坛?

从300元暴跌到10元,网红葡萄“阳光玫瑰”为何跌落神坛? 0.199风阻系数+8K大屏 吉利银河E8线上首发

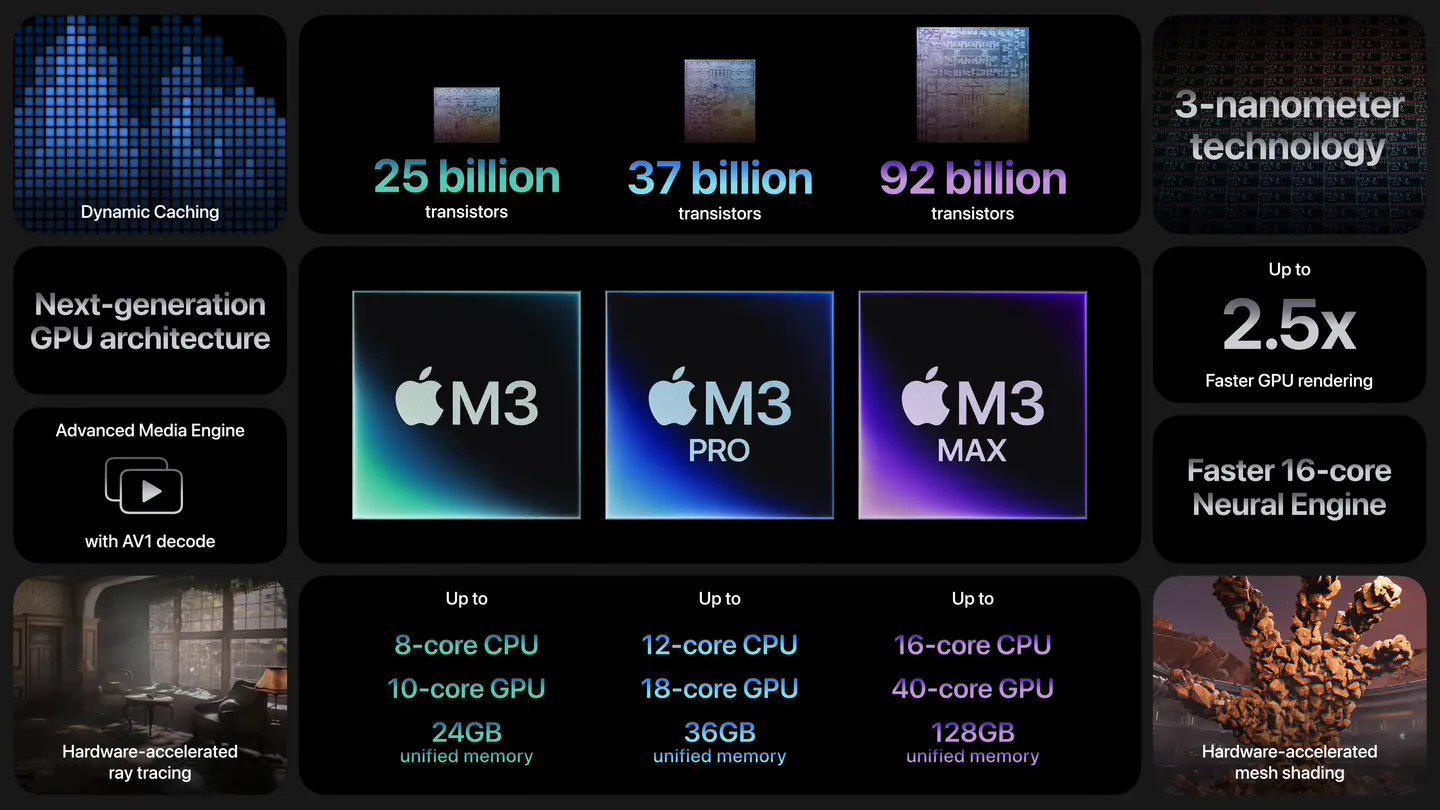

0.199风阻系数+8K大屏 吉利银河E8线上首发 外媒评苹果发布会:除了芯片,最大变化是"深空黑色"

外媒评苹果发布会:除了芯片,最大变化是"深空黑色" 意甲:AC米兰0-1尤文图斯,失榜首,洛卡特利反戈旧主,佳夫染红

意甲:AC米兰0-1尤文图斯,失榜首,洛卡特利反戈旧主,佳夫染红 复古风格尽显/搭4.0T动力 全新红旗L5实车曝光

复古风格尽显/搭4.0T动力 全新红旗L5实车曝光 3-2!葡萄牙双杀斯洛伐克,7连胜提前进欧洲杯,C罗双响,创历史

3-2!葡萄牙双杀斯洛伐克,7连胜提前进欧洲杯,C罗双响,创历史 起亚发布EV3和EV4概念车 颜值很高 内有巨屏

起亚发布EV3和EV4概念车 颜值很高 内有巨屏 全红婵/陈芋汐领先日本85分 女双十米台碾压夺冠

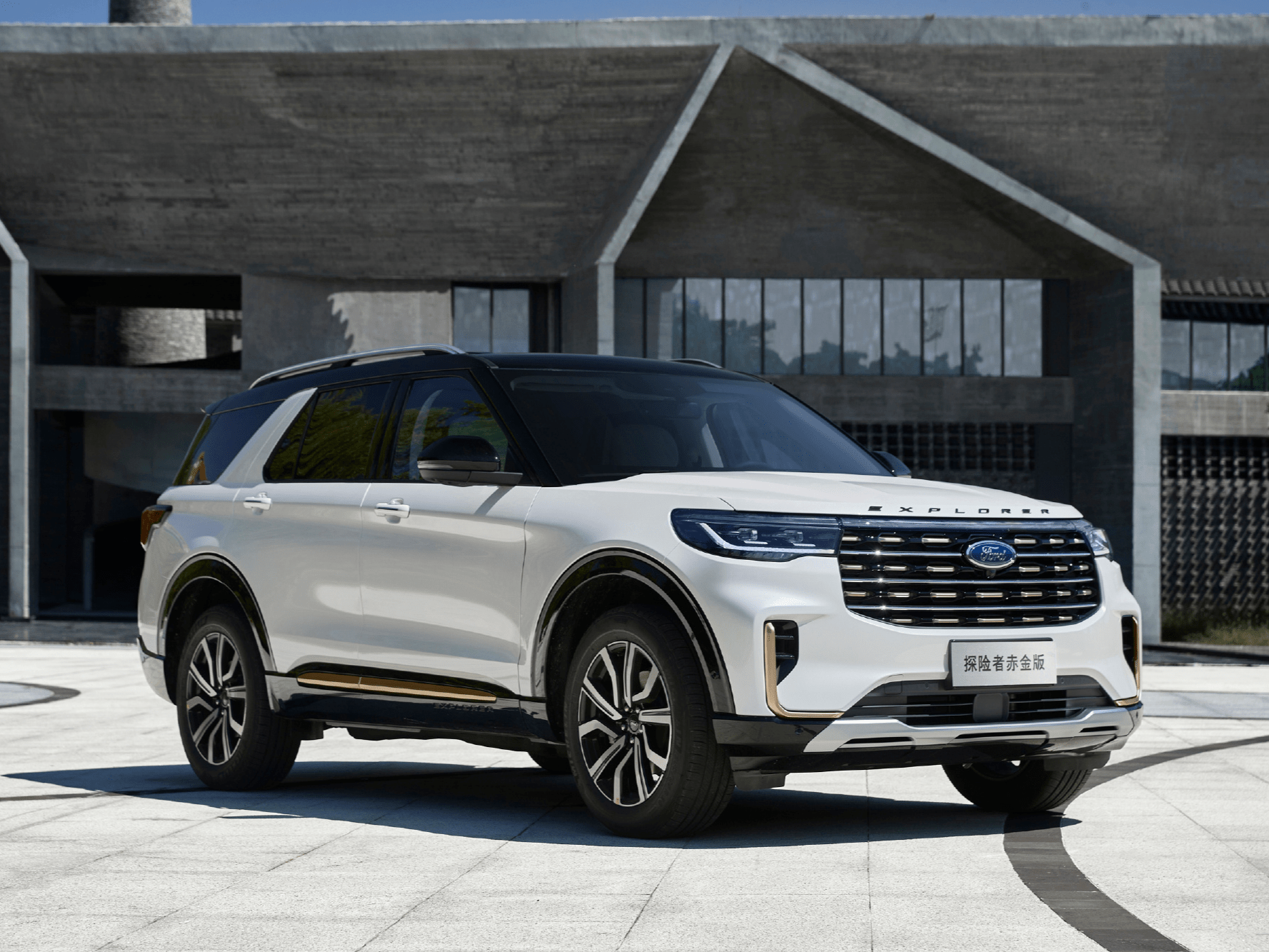

全红婵/陈芋汐领先日本85分 女双十米台碾压夺冠 内装更豪华 福特探险者赤金版将于10月4日上市

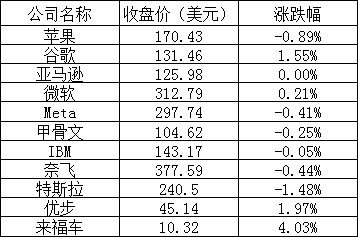

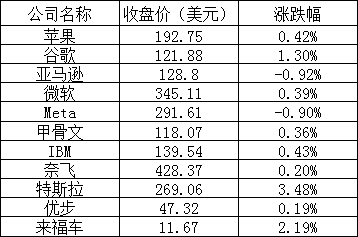

内装更豪华 福特探险者赤金版将于10月4日上市 美股周三:大型科技股涨跌不一,热门中概股普涨

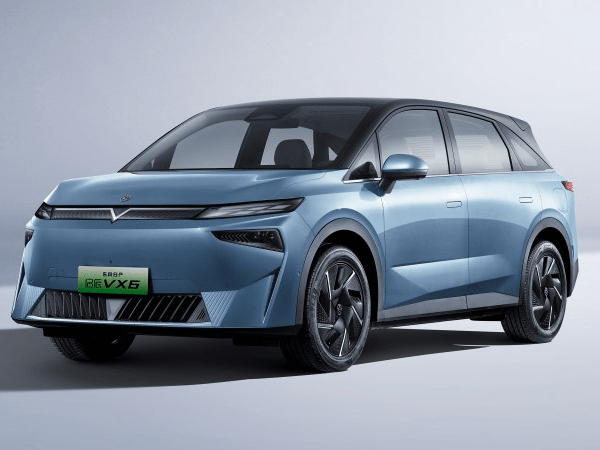

美股周三:大型科技股涨跌不一,热门中概股普涨 基于概念车设计/定位纯电紧凑SUV 启辰VX6官图发布

基于概念车设计/定位纯电紧凑SUV 启辰VX6官图发布 马斯克展示得州超级工厂新大门,采用大量反光元素

马斯克展示得州超级工厂新大门,采用大量反光元素 乌戈·洛佩斯正式出任辽篮主教练!感谢杨鸣指导的辛勤付出!

乌戈·洛佩斯正式出任辽篮主教练!感谢杨鸣指导的辛勤付出! 奇瑞新能源产品序列定名风云 首款车型四季度亮相

奇瑞新能源产品序列定名风云 首款车型四季度亮相 易建联退役:笑着面对篮球的难

易建联退役:笑着面对篮球的难 蔚来全新EC6售35.8万起 标配第二代女王副驾

蔚来全新EC6售35.8万起 标配第二代女王副驾 西媒:国家队比赛日后皇马迎来紧密赛程,安切洛蒂将进行轮换

西媒:国家队比赛日后皇马迎来紧密赛程,安切洛蒂将进行轮换 全新设计元素/DMH混动系统 荣威D5X实车曝光

全新设计元素/DMH混动系统 荣威D5X实车曝光 德约3-0复仇梅德韦杰夫!美网第4度称王,大满贯24冠成历史第1人

德约3-0复仇梅德韦杰夫!美网第4度称王,大满贯24冠成历史第1人 充电8分钟续航100km 2024款几何G6售11.98万起

充电8分钟续航100km 2024款几何G6售11.98万起 世界杯-加拿大男篮胜斯洛文尼亚进4强 东契奇遭驱逐

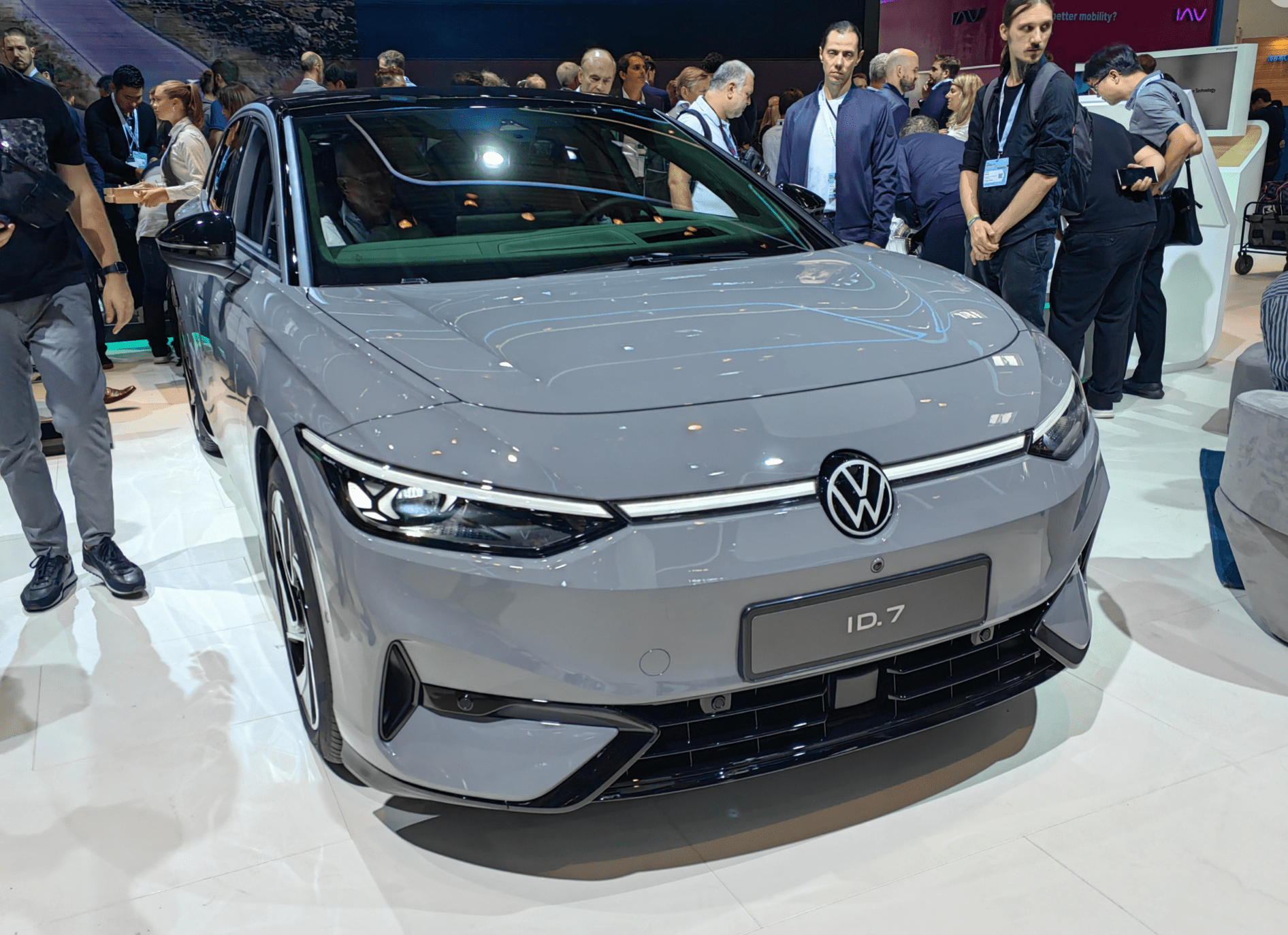

世界杯-加拿大男篮胜斯洛文尼亚进4强 东契奇遭驱逐 纯电轿跑/起售价45万 大众ID.7于慕尼黑车展亮相

纯电轿跑/起售价45万 大众ID.7于慕尼黑车展亮相 张钹: 硅基机器是否能产生意识?目前只有哲学上的争论

张钹: 硅基机器是否能产生意识?目前只有哲学上的争论 召集懂“势”达人 腾势品牌全系车型亮相成都车展

召集懂“势”达人 腾势品牌全系车型亮相成都车展 比亚迪唐系列新车售价24.98万元-30.98万元,唐DM-p冠军版综合续航超1000KM

比亚迪唐系列新车售价24.98万元-30.98万元,唐DM-p冠军版综合续航超1000KM 世界杯-中国男篮20分负南苏丹2连败 李凯尔22分

世界杯-中国男篮20分负南苏丹2连败 李凯尔22分 新配色/售8.98万 吉利缤瑞COOL冠军版上市

新配色/售8.98万 吉利缤瑞COOL冠军版上市 封面评论 | 从新奇到泛滥,“文创雪糕”的生意无关人文抒情

封面评论 | 从新奇到泛滥,“文创雪糕”的生意无关人文抒情 底盘/电驱/热控都上新了 哪吒发布全新技术品牌

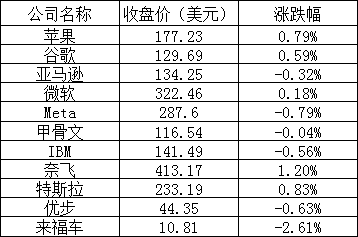

底盘/电驱/热控都上新了 哪吒发布全新技术品牌 美股周二:三大股指涨跌不一,英伟达跌逾2%,百度涨近3%

美股周二:三大股指涨跌不一,英伟达跌逾2%,百度涨近3% 11-10!梅西44冠,迈阿密首冠:球王被抛起庆祝,太嗨了

11-10!梅西44冠,迈阿密首冠:球王被抛起庆祝,太嗨了 新岚图FREE售26.69万 智驾升级还标配空悬

新岚图FREE售26.69万 智驾升级还标配空悬 梅西:从未重视金球奖 世界杯夺冠后更不考虑 不想离开巴萨去巴黎

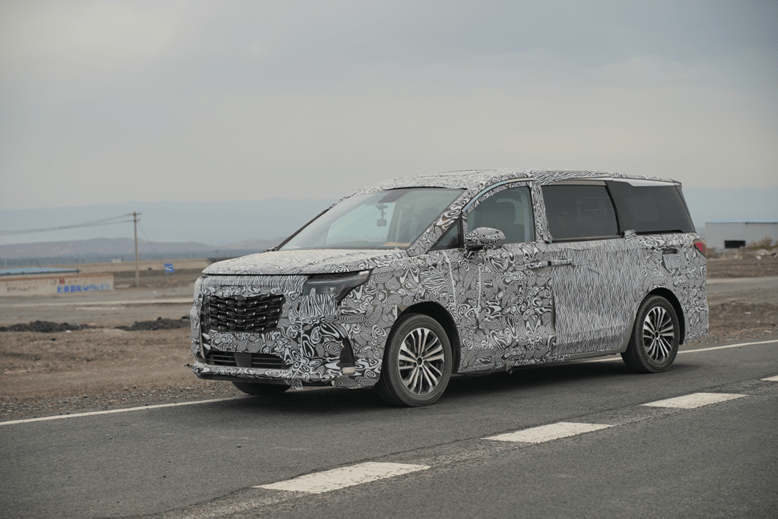

梅西:从未重视金球奖 世界杯夺冠后更不考虑 不想离开巴萨去巴黎 成都车展首发 江淮瑞风RF8插混版谍照曝光

成都车展首发 江淮瑞风RF8插混版谍照曝光 欧超杯:曼城6-5逆转塞维利亚,21岁新星救主,瓜迪奥拉加冕4冠王

欧超杯:曼城6-5逆转塞维利亚,21岁新星救主,瓜迪奥拉加冕4冠王 轴距加长/换全新1.3T动力 全新逍客售13.99万-17.49万

轴距加长/换全新1.3T动力 全新逍客售13.99万-17.49万 4-1,杀进决赛!梅西32米传球入网,迈阿密创2大历史纪录

4-1,杀进决赛!梅西32米传球入网,迈阿密创2大历史纪录 国产起亚EV5实车首曝 纯电紧凑SUV 配单电机

国产起亚EV5实车首曝 纯电紧凑SUV 配单电机 马斯克再放狠话:扎克伯格一回家,就将登门讨教

马斯克再放狠话:扎克伯格一回家,就将登门讨教 阿拉冠:利雅得胜利加时2-1逆转夺冠!C罗双响伤退 5场6球获金靴

阿拉冠:利雅得胜利加时2-1逆转夺冠!C罗双响伤退 5场6球获金靴 新奥迪Q3家族售27.98万起 全新配色还有新动力

新奥迪Q3家族售27.98万起 全新配色还有新动力 阿拉冠:利雅得胜利1-0进决赛!马内造点 C罗连续4场破门冲首冠

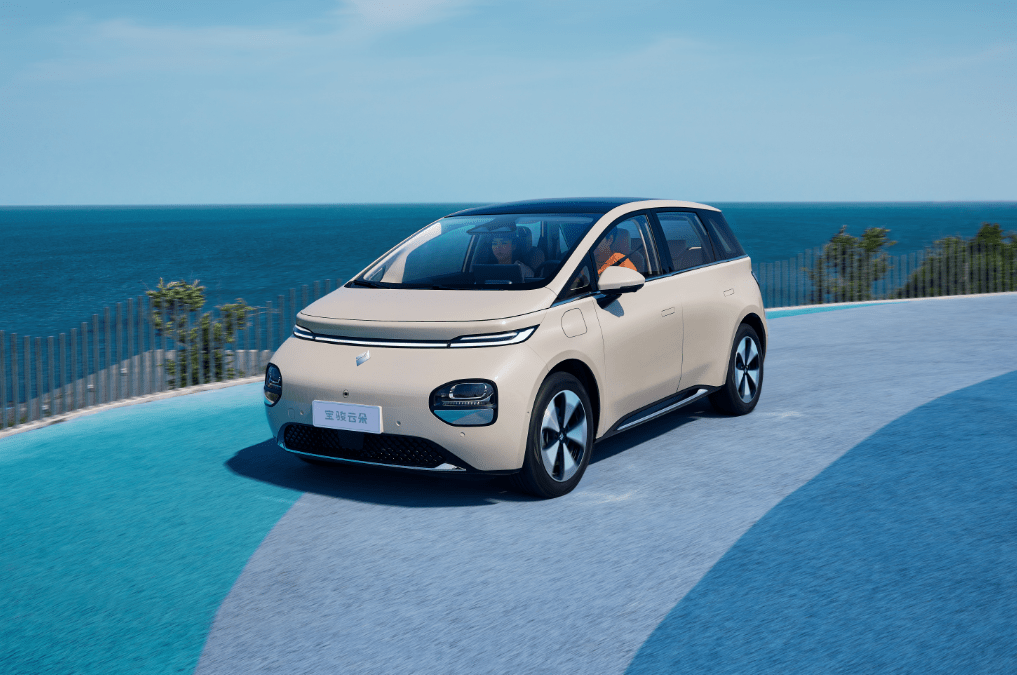

阿拉冠:利雅得胜利1-0进决赛!马内造点 C罗连续4场破门冲首冠 宝骏云朵今晚上市 自带大沙发还能语音交互

宝骏云朵今晚上市 自带大沙发还能语音交互 动力升级/增加新配色 新奥迪Q3将于8月中旬上市

动力升级/增加新配色 新奥迪Q3将于8月中旬上市 腾势N8售31.98万起 座椅标配拉满还能k歌玩游戏

腾势N8售31.98万起 座椅标配拉满还能k歌玩游戏 李凯尔中国队首秀11+6!多次空切+压哨命中 乔帅连吃两T被驱逐

李凯尔中国队首秀11+6!多次空切+压哨命中 乔帅连吃两T被驱逐 9.9元的咖啡一大把,“万店瑞幸”只有一个

9.9元的咖啡一大把,“万店瑞幸”只有一个 阿拉冠-C罗绝平马内首秀特莱斯送点 利雅得胜利1-1扎马雷克进8强

阿拉冠-C罗绝平马内首秀特莱斯送点 利雅得胜利1-1扎马雷克进8强 哪吒AYA售7.38万起 标配14.6英寸大屏还有新配色

哪吒AYA售7.38万起 标配14.6英寸大屏还有新配色 女足世界杯-王霜难救主 中国1-6英格兰小组出局

女足世界杯-王霜难救主 中国1-6英格兰小组出局 盲订开启/上海购车送绿牌 宝骏云朵8月10日将上市

盲订开启/上海购车送绿牌 宝骏云朵8月10日将上市 中超-费莱尼费南多破门李源一传射 泰山3-0国安

中超-费莱尼费南多破门李源一传射 泰山3-0国安 比亚迪宋L猎装SUV谍照首曝

比亚迪宋L猎装SUV谍照首曝 外观更霸气 改款福特锐际或于成都车展发布

外观更霸气 改款福特锐际或于成都车展发布 定了!6亿美元入股!又有汽车巨头为补强电动化掏腰包

定了!6亿美元入股!又有汽车巨头为补强电动化掏腰包 售15.27万元起 天逸C5 AIRCROSS 2023款开启预订

售15.27万元起 天逸C5 AIRCROSS 2023款开启预订 美股周一:热门中概股普涨,蔚来B站涨逾10%

美股周一:热门中概股普涨,蔚来B站涨逾10% 大韩美食征服天下!韩餐全球宣传片惨变笑话:白人吃草 黑人舔筷

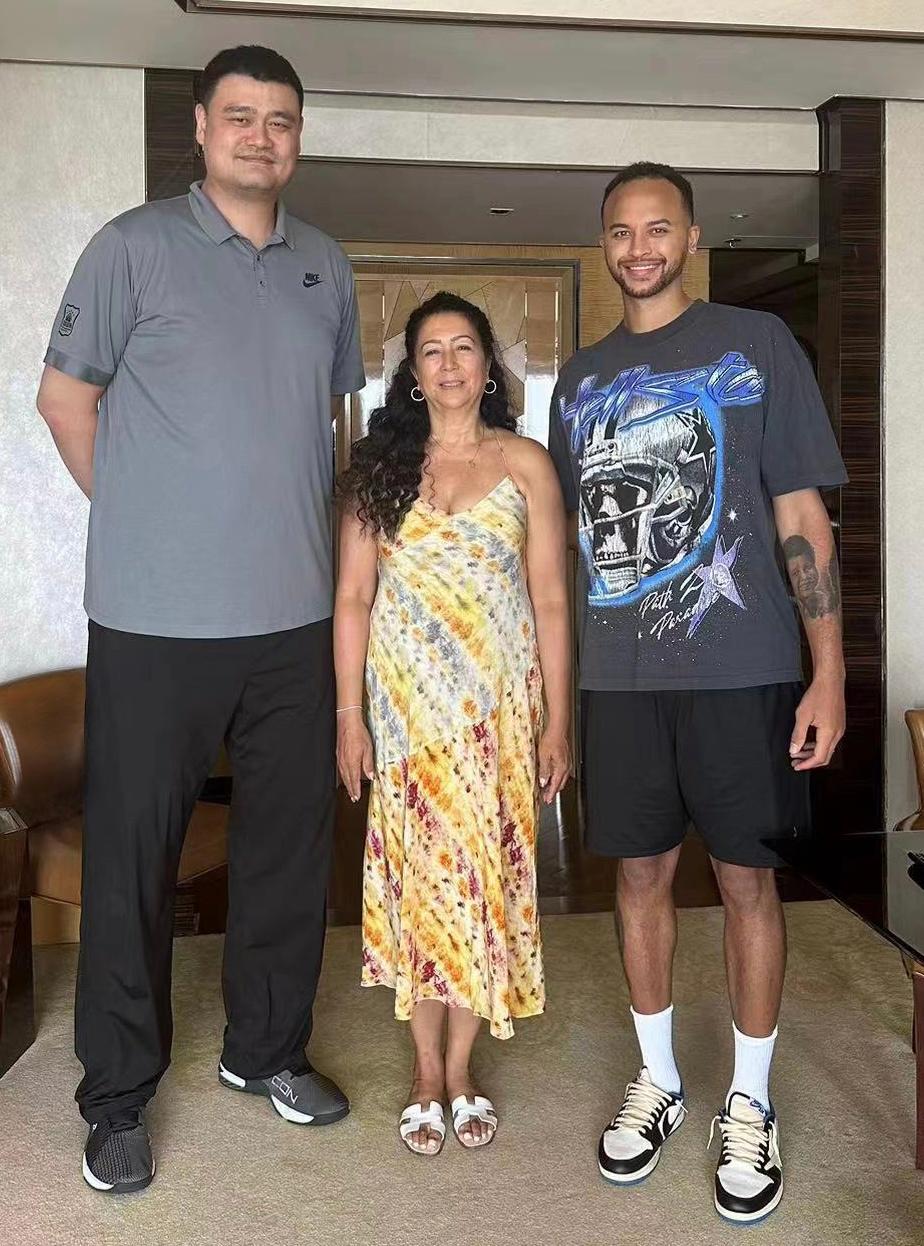

大韩美食征服天下!韩餐全球宣传片惨变笑话:白人吃草 黑人舔筷 篮协官方宣布李凯尔获中国国籍 姚明合影李凯尔

篮协官方宣布李凯尔获中国国籍 姚明合影李凯尔 阿维塔12将三季度亮相 车长超5米配双电机

阿维塔12将三季度亮相 车长超5米配双电机 0-1,爆大冷!世界冠军轰然倒下,后防线被击穿,中国女足学着点

0-1,爆大冷!世界冠军轰然倒下,后防线被击穿,中国女足学着点 360km/460km两种续航 宝骏云朵三电系统发布

360km/460km两种续航 宝骏云朵三电系统发布 1-0!女足世界杯揭幕战爆大冷,新西兰击败挪威,队史首胜诞生

1-0!女足世界杯揭幕战爆大冷,新西兰击败挪威,队史首胜诞生 新款雪佛兰创酷RS售10.99万起 标配10.25吋双屏

新款雪佛兰创酷RS售10.99万起 标配10.25吋双屏 马斯克的锅?特斯拉大跌近10%,市值一夜蒸发约6453亿元

马斯克的锅?特斯拉大跌近10%,市值一夜蒸发约6453亿元 489.65分!中国队收获世锦赛第9金,混合团体跳水断层领先夺冠

489.65分!中国队收获世锦赛第9金,混合团体跳水断层领先夺冠 别克新款君威外观公布 全新前脸新潮又动感

别克新款君威外观公布 全新前脸新潮又动感 比亚迪海洋网混动轿车定名海豹DM-i 三季度上市

比亚迪海洋网混动轿车定名海豹DM-i 三季度上市 知乎创始人周源:新职人工作生活都在乎,知乎想法内容量增89%

知乎创始人周源:新职人工作生活都在乎,知乎想法内容量增89% 星星的味道

星星的味道 阿森纳新标王诞生!赖斯成夏窗第三签,转会费1.05亿周薪24万

阿森纳新标王诞生!赖斯成夏窗第三签,转会费1.05亿周薪24万 阿维塔12实车首曝 高颜值中大型纯电轿车

阿维塔12实车首曝 高颜值中大型纯电轿车 官方:罗马租借利兹联后卫克里斯滕森,租期一年身披43号

官方:罗马租借利兹联后卫克里斯滕森,租期一年身披43号 首款车型年内交付 方程豹汽车LOGO发布

首款车型年内交付 方程豹汽车LOGO发布 比亚迪“大爆发”!半年净利润超105亿,预增192%-225%!6月销量是特斯拉3倍

比亚迪“大爆发”!半年净利润超105亿,预增192%-225%!6月销量是特斯拉3倍 3-6,2-6!李娜再输球,携手A拉遭遇两连败,提前无缘小组出线

3-6,2-6!李娜再输球,携手A拉遭遇两连败,提前无缘小组出线 提供敞篷版可选/或5.99万起售 奔腾小马本月上市

提供敞篷版可选/或5.99万起售 奔腾小马本月上市 京东健康发布医疗大模型“京医千询”

京东健康发布医疗大模型“京医千询” 还没谈好?宋翔曝周琦交易重要方面仍未达成一致,不会变卦吧?

还没谈好?宋翔曝周琦交易重要方面仍未达成一致,不会变卦吧? 设计全面升级 全新荣威i5将于7月12日上市

设计全面升级 全新荣威i5将于7月12日上市 百川智能发布Baichuan-13B:参数量130亿

百川智能发布Baichuan-13B:参数量130亿 马刺无缘19分大逆转:文班亚马27+12+3帽秀暴扣 末节10分连中三分

马刺无缘19分大逆转:文班亚马27+12+3帽秀暴扣 末节10分连中三分

全部评论 0